本地模型2 我们支持使用llamafactory来运行本地模型,这个方式比LLamaSharp可支持的模型种类更多,目前支持36种主流的离线模型 包括 baichuan、ChatGlm、Yi、yuan、Qwen等

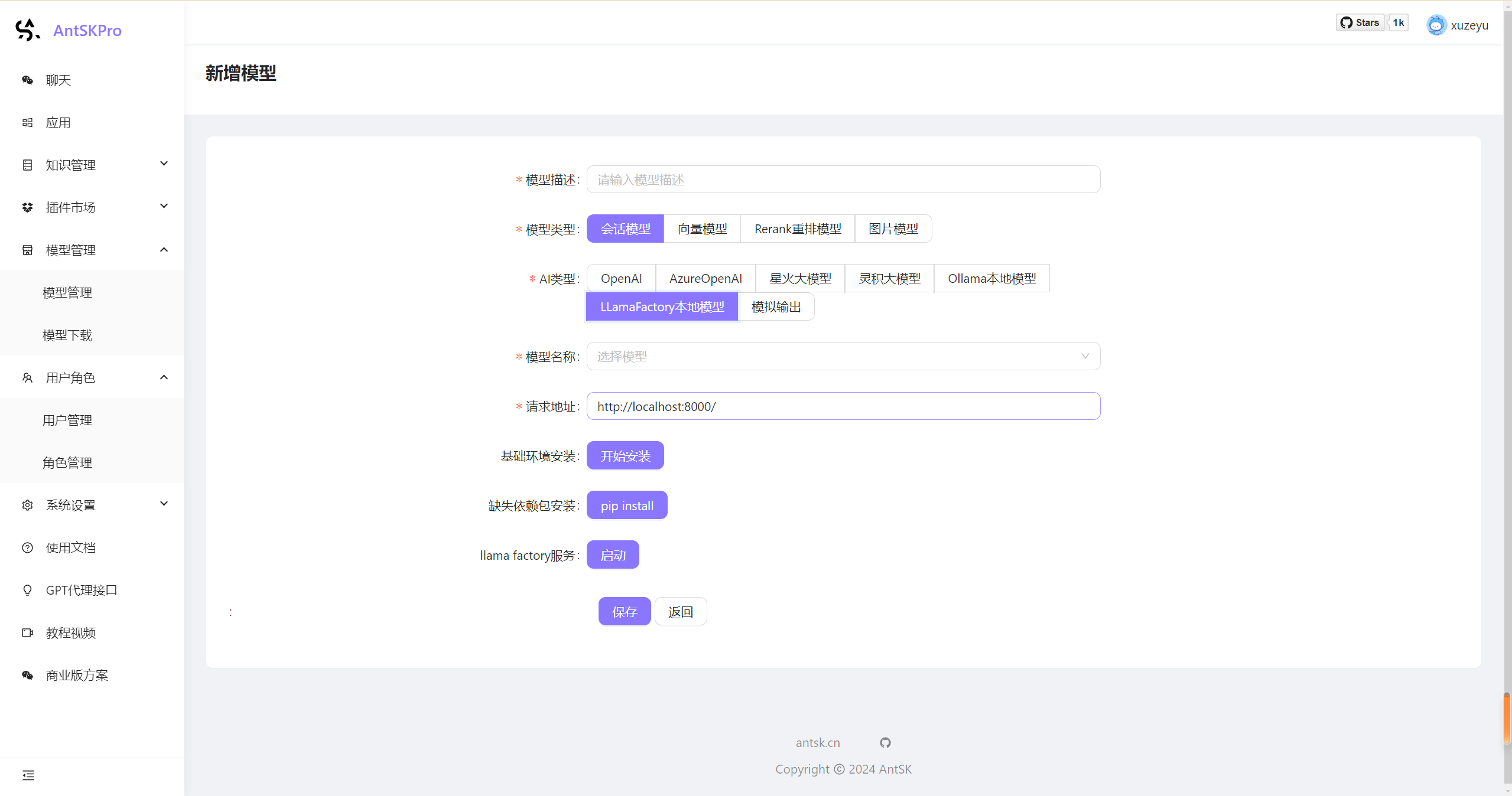

我们在新建模时选择llamafactory,然后选择自己的模型

这里需要注意:如果是本地调试需要自行安装python环境

如果使用容器 需要使用p开头的镜像,例如 v0.5.0 版本对于的 包含python环境的镜像版本是 p0.5.0

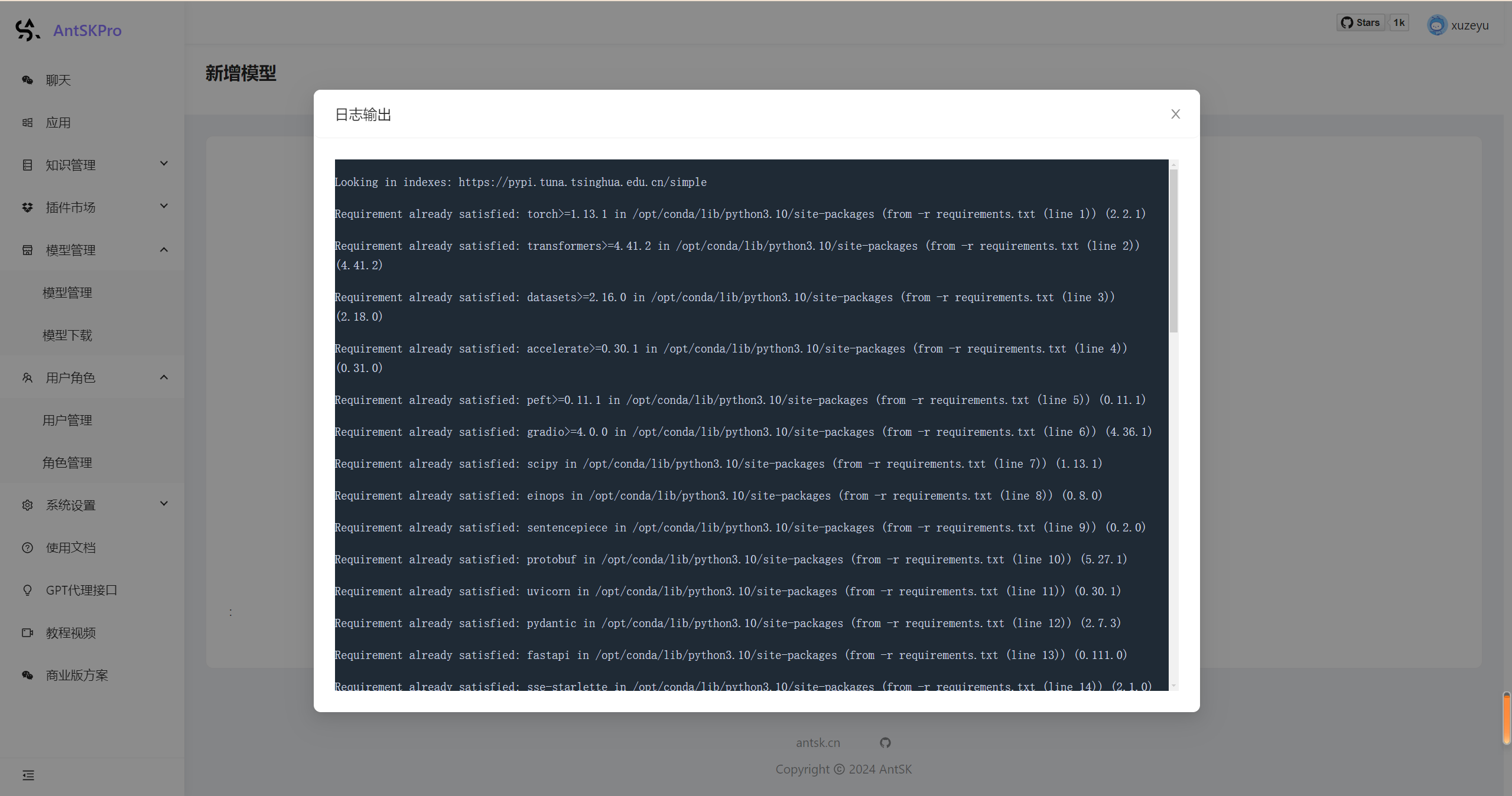

选择好模型以后我们先点击初始化,这个只需第一次执行即可,这里会自动执行pip install 安装环境依赖

然后我们点击启动

在请求地址输入: http://localhost:8000/ 点击保存即可。